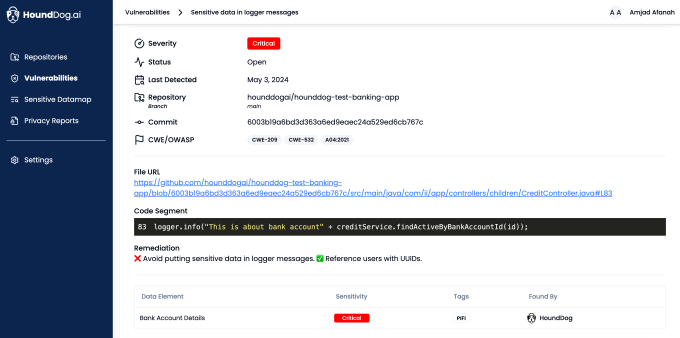

HoundDog.ai, une startup qui aide les développeurs à garantir que leur code ne divulgue pas d'informations personnelles identifiables (PII), est sortie furtivement mercredi et a annoncé un tour de table de 3,1 millions de dollars mené par E14, Mozilla Ventures et ex/ante, en plus d'un nombre d’investisseurs providentiels. Contrairement à d'autres outils d'analyse, HoundDog examine le code qu'un développeur écrit, en utilisant à la fois la correspondance de modèles traditionnelle et les grands modèles de langage (LLM) pour détecter les problèmes potentiels.

HoundDog a été fondée par Amjad Afanah, qui avait auparavant cofondé DCHQ, qui a ensuite été acquis par Gridstore (qui, pour compliquer les choses, a ensuite changé son nom en HyperGrid) en 2016. Afanah a également cofondé apisec.ai, qui est toujours en activité. et courir, et a travaillé pour la startup autonome Cruise. L'inspiration pour HoundDog est venue pendant son séjour au sein de la startup de sécurité des données Cyral et en discutant avec les équipes de confidentialité là-bas, m'a-t-il dit.

« Quand j'étais chez Cyral, nous avions beaucoup de données », a-t-il déclaré. « Ce que fait Cyral, comme beaucoup d'autres dans le domaine de la sécurité des données, c'est qu'ils se concentrent sur les systèmes de production. Ils vous aident à découvrir, classer vos données structurées et vos bases de données, puis à appliquer des contrôles d'accès. Mais les retours massifs que j'entendais de la part des équipes de sécurité et de confidentialité étaient les suivants : « Vous savez, c'est un peu trop réactif et il ne suit pas les changements dans la base de code. »

HoundDog déplace donc ce processus encore plus à gauche. Bien qu'il se trouve toujours dans le flux d'intégration continue et pas encore dans l'environnement de développement (même si cela pourrait arriver dans le futur), l'idée ici est de détecter les fuites de données potentielles avant que le code ne soit fusionné. Et plus important encore, HoundDog le fait en examinant le code lui-même, et non le flux de données qu'il produit. « Notre source de vérité est la base du code », a déclaré Afanah.

Grâce à cela, si une équipe de développement commence à collecter des numéros de sécurité sociale, par exemple, HoundDog lèvera un drapeau et en avertira l'équipe avant que le code ne soit fusionné ; cela alerterait également l’équipe de sécurité. Après tout, cela pourrait potentiellement être un problème majeur – et coûteux.

Le service prend actuellement en charge le code écrit en Java, C#, JavaScript et TypeScript, ainsi que les requêtes SQL, GraphQL et OpenAPI/Swagger. La prise en charge de Python est imminente, indique la société.

Afanah a noté qu'un outil comme celui-ci devient particulièrement important à l'ère du code généré par l'IA, ce que Amjad Masad, PDG de Replit (et investisseur providentiel de HoundDog), a également fait écho.

« Alors qu'un nombre croissant d'entreprises se tournent vers le code généré par l'IA pour accélérer leur développement, il devient essentiel d'intégrer les meilleures pratiques de sécurité et de garantir la sécurité du code généré », a déclaré Masad. « HoundDog.ai ouvre la voie en matière de sécurisation des données PII dès le début du cycle de développement, ce qui en fait un composant indispensable de tout flux de travail de génération de code IA. C'est la raison pour laquelle j'ai choisi d'investir dans cette entreprise.

HoundDog lui-même utilise également l’IA. Pour ce faire, il s'appuie actuellement sur les modèles d'OpenAI, mais il est important de souligner que cela est facultatif. Les utilisateurs qui craignent que leur code quitte leurs référentiels privés peuvent également choisir de s'appuyer uniquement sur le scanner de code plus traditionnel de l'entreprise.

Une grande partie de la proposition de valeur de HoundDog réside dans la possibilité de réduire les coûts de conformité pour les startups grâce à ses capacités de reporting automatisées. Le service peut générer automatiquement un enregistrement des activités de traitement (RoPA). Pour ce faire, HoundDog utilise l'IA générative pour générer ces rapports et envoie ces données à OpenAI. L'équipe souligne que seuls les jetons découverts par le service via son scanner habituel sont partagés avec OpenAI et que le code source réel n'est pas partagé.

La société propose un forfait gratuit limité, avec des forfaits payants à partir de 200 $/mois pour analyser jusqu'à deux dépôts.