Points clés à retenir

- AWS Bedrock permet aux startups d'adopter l'IA générative sans gérer l'infrastructure ML ou les clusters GPU.

- Les plates-formes LLM gérées réduisent la complexité, l'incertitude des coûts et les risques opérationnels pour les équipes en démarrage.

- Bedrock permet à l'IA de fonctionner comme un service cloud composable, facilement intégré aux architectures sans serveur.

- Des prix prévisibles, une sécurité intégrée et une conformité rendent Bedrock adapté aux secteurs réglementés.

- Les startups gagnent en flexibilité stratégique en se concentrant sur l’architecture et l’impact des produits plutôt que sur la maintenance du modèle.

Au cours de la dernière décennie de création de systèmes cloud natifs et sans serveur, l’industrie a vu des vagues après vagues de technologies « transformationnelles » aller et venir. Certains étaient surfaits. Certains étaient en avance sur leur temps. Et quelques-uns ont véritablement remodelé la façon dont les équipes créent des logiciels.

L'IA générative – et plus particulièrement l'émergence de plateformes LLM gérées comme AWS Bedrock – appartient résolument à cette dernière catégorie.

Mais pas pour les raisons que beaucoup attendent.

La vraie valeur de Bedrock ne réside pas dans ses modèles, sa marque ou même ses références de performances. Son véritable pouvoir réside dans la liberté stratégique qu’il accorde aux développeurs, aux fondateurs et aux équipes produit, en particulier dans les startups en phase de démarrage.

Où les startups ont vraiment du mal avec l'IA (et pourquoi Bedrock change l'équation)

Dans les conversations avec les fondateurs de startups, le même schéma apparaît encore et encore :

- Les fonctionnalités d’IA sont nécessaires pour rester compétitif

- L'embauche d'une équipe ML ou la maintenance de clusters GPU n'est pas réalisable

- Les coûts semblent imprévisibles et risqués

- Il y a une pression intense pour expédier hier

L'IA générative peut sembler perturbatrice, mais pour les petites équipes, elle peut rapidement devenir perturbatrice dans le mauvais sens : architectures surchargées, coûts en spirale, risques de conformité et frais généraux opérationnels.

AWS Bedrock inverse cette dynamique.

Il permet aux équipes d'adopter l'IA de la même manière qu'elles adoptent n'importe quel autre service AWS géré : via une abstraction cohérente, sécurisée et évolutive, sans avoir besoin d'exploiter une infrastructure de ML.

Pour une startup en phase d’amorçage, cela peut faire la différence entre :

- expédier un MVP en trois mois plutôt que de ne jamais le lancer

- impressionner les investisseurs plutôt que de se retrouver dans des impasses techniques

- modélisation des coûts prévisibles par rapport aux factures GPU incontrôlables

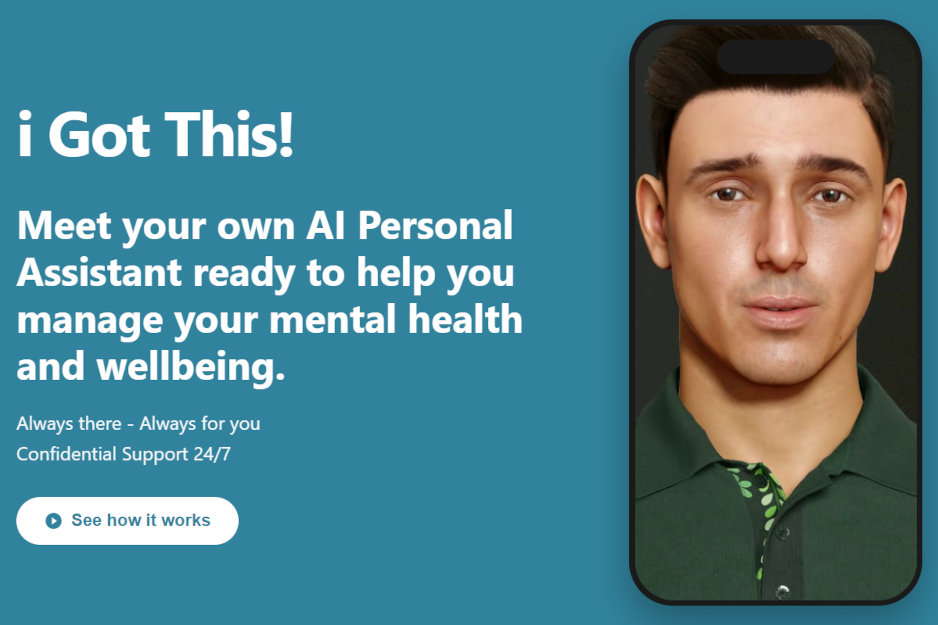

Exemple concret : « Je comprends ! » – Un assistant IA en santé mentale conçu de la bonne manière

Un récent projet Perfsys illustre clairement ce changement.

j'ai compris ! est une startup de santé mentale fondée avec une mission puissante : créer un compagnon d'IA empathique qui soutient émotionnellement les utilisateurs entre les séances de thérapie.

Il s'agit d'un produit conçu pour véritablement améliorer la vie, mais qui exige également une sensibilité, une intimité et une sécurité exceptionnelles.

Traditionnellement, construire quelque chose comme ceci nécessiterait :

- PNL personnalisé ou réglage fin de grands modèles

- gestion importante des infrastructures

- ingénieurs ML dédiés

- mise en œuvre de conformité complexe

Pour la plupart des startups, ce niveau d’investissement est tout simplement irréaliste.

Au lieu de cela, la solution a été construite à l'aide d'AWS Bedrock combiné à une architecture AWS entièrement sans serveur.

Intégration d'Avatar dans le cloud AWS à l'aide du framework AWS Amplify et de l'autorisation AWS Cognito.

Ce que cette architecture a permis

- Un agent conversationnel alimenté par AWS Bedrock avec des garde-fous de sécurité émotionnelle soigneusement conçus

- Un backend évolutif utilisant AWS Lambda, API Gateway, DynamoDB, Cognito, S3 et CloudWatch

- Une conception modulaire séparant l'interface utilisateur de l'avatar de la logique de l'IA, permettant une flexibilité future

- Infrastructure sans opérations afin que l'équipe puisse se concentrer sur le produit et non sur les serveurs

- Plus de 90 % d’économies par rapport à la plateforme d’avatar externe initialement envisagée

- Un MVP prêt pour les investisseurs, livré en quelques mois, et non en années

Ce n’était pas une preuve de concept. Il s'agissait d'une base de production conçue autour des contraintes réelles d'une startup : budget limité, sensibilité réglementaire et besoin de rapidité.

Le projet renforce une leçon essentielle : le succès d’une startup ne consiste pas à tout construire à partir de zéro. Il s'agit de créer les bonnes choses et de laisser le cloud gérer le reste.

La plus grande leçon pour les développeurs et les CTO

Lors de l’évaluation de nouvelles technologies, une question compte plus que toute autre :

Cela réduit-il la complexité sans limiter la croissance future ?

Avec AWS Bedrock, la réponse est clairement oui.

1. L'IA devient une primitive cloud composable

Aucun pipeline ML personnalisé. Aucune instance GPU. Aucune décision d’hébergement de modèle.

Juste une API – une API qui s'intègre parfaitement aux flux de travail, aux pipelines CI/CD et aux applications sans serveur existants.

2. Coûts prévisibles et mise à l’échelle transparente

La tarification basée sur les jetons offre aux startups quelque chose d’inestimable : la prévisibilité financière.

3. Conception indépendante du fournisseur sans verrouillage

Avec plusieurs modèles disponibles derrière une seule API, l'évolution ou le changement de stratégie de modèle devient réalisable, voire trivial.

4. Sécurité, identité et conformité intégrées

Pour les domaines sensibles comme la santé mentale, les technologies financières et les soins de santé, hériter de la posture de conformité d'AWS constitue un avantage majeur.

L'IA n'est plus un mot à la mode : c'est une infrastructure

L’une des erreurs les plus courantes commises par les équipes est de traiter l’IA comme une fonctionnalité ou un module complémentaire.

L’histoire montre que les technologies qui perdurent – Lambda, DynamoDB, S3, Step Functions – sont celles qui réduisent les frictions et augmentent la vitesse.

AWS Bedrock rejoint cette liste.

Pas parce que c'est flashy. Pas parce que c'est tendance. Mais parce qu’il permet à de vraies équipes, opérant sous de vraies contraintes, de résoudre de vrais problèmes.

Le J'ai compris ! MVP n'a pas réussi à cause du battage médiatique de l'IA. Cela a réussi parce que l'architecture a permis à une petite équipe d'agir rapidement, de rester en sécurité et de se concentrer sur l'impact sur les utilisateurs.

C'est l'avenir de l'IA cloud native.

Un message aux fondateurs et aux dirigeants de l'ingénierie

Si l’IA est envisagée pour un nouveau produit ou un MVP, le conseil est simple :

Ne commencez pas par le modèle. Commencez par l’architecture.

Concevez des systèmes qui traitent l’IA comme un service – modulaire, sécurisé et dont les coûts sont maîtrisés – et les équipes obtiennent la liberté d’innover rapidement sans accumuler de dette technique à long terme.

Les plates-formes comme AWS Bedrock ne remplacent pas une bonne ingénierie.

Ils l'amplifient.

Et dans un monde de startups où le temps et la concentration sont les atouts les plus précieux, cette amplification peut être un avantage déterminant.

FAQ

Qu'est-ce qu'AWS Bedrock ?

AWS Bedrock est un service géré qui donne accès à plusieurs grands modèles de langage via une API unifiée. Il permet aux équipes d’intégrer des capacités d’IA générative sans héberger ni exploiter d’infrastructure d’apprentissage automatique.

Pourquoi AWS Bedrock est-il particulièrement utile pour les startups ?

Les startups manquent souvent de ressources pour embaucher des équipes ML ou gérer des charges de travail gourmandes en GPU. Bedrock supprime ce fardeau en offrant des capacités d'IA évolutives et sécurisées avec des coûts prévisibles et des frais opérationnels minimes.

Comment AWS Bedrock réduit-il la complexité technique ?

Bedrock fait abstraction de l'hébergement, de la mise à l'échelle et de la gestion de l'infrastructure des modèles. Les développeurs interagissent avec l’IA via des API standards qui s’intègrent naturellement dans les workflows sans serveur et cloud natifs.

L'utilisation d'AWS Bedrock crée-t-elle une dépendance vis-à-vis du fournisseur ?

Bien que Bedrock soit un service AWS, il prend en charge plusieurs modèles derrière une seule interface. Cela permet aux équipes de modifier ou de faire évoluer les stratégies de modèle sans repenser l'ensemble de leur système.

AWS Bedrock est-il adapté aux cas d'utilisation sensibles ou réglementés ?

Oui. En héritant des contrôles de sécurité, d'identité et de conformité d'AWS, Bedrock est bien adapté aux domaines tels que la santé, la santé mentale et la technologie financière, où la protection des données est essentielle.

Comment AWS Bedrock prend-il en charge des coûts prévisibles ?

Bedrock utilise une tarification basée sur des jetons, offrant aux équipes une visibilité plus claire sur l'utilisation et les dépenses. Cette prévisibilité est particulièrement importante pour les startups qui gèrent des budgets serrés.

Quelle est la principale leçon d’architecture tirée de cas d’utilisation de startups comme « i Got This ! » ?

La leçon clé est de traiter l’IA comme une infrastructure plutôt que comme une fonctionnalité autonome. En concevant des systèmes modulaires et sans serveur autour de services d’IA gérés, les startups peuvent évoluer plus rapidement sans accumuler de dette technique.