Lakera, une startup suisse qui développe une technologie pour protéger les applications d'IA générative contre les messages malveillants et autres menaces, a levé 20 millions de dollars lors d'un tour de série A mené par la société de capital-risque européenne Atomico.

L'IA générative est devenue l'emblème du mouvement naissant de l'IA, porté par des applications populaires telles que ChatGPT. Mais elle reste une source de préoccupation dans les entreprises, en grande partie en raison de problèmes liés à la sécurité et à la confidentialité des données.

Pour mettre les choses en contexte, les grands modèles de langage (LLM) sont les moteurs de l’IA générative et permettent aux machines de comprendre et de générer du texte comme un humain. Mais que vous souhaitiez qu’une telle application écrive un poème ou résume un contrat juridique, elle a besoin d’instructions pour guider sa sortie. Ces « invites » peuvent cependant être construites de manière à tromper l’application et l’amener à faire quelque chose qu’elle n’est pas censée faire, comme divulguer des données confidentielles qui ont été utilisées pour l’entraîner, ou donner un accès non autorisé à des systèmes privés. De telles « injections d’invites » constituent une préoccupation réelle et croissante, et c’est précisément ce à quoi Lakera s’efforce de remédier.

Réponse rapide

Fondée à Zurich en 2021, Lakera a été officiellement lancée en octobre dernier avec un financement de 10 millions de dollars, avec la promesse expresse de protéger les organisations contre les faiblesses de sécurité des LLM telles que les fuites de données ou les injections rapides. Elle fonctionne avec n'importe quel LLM, y compris GPT-X d'OpenAI, Bard de Google, LLaMA de Meta et Claude d'Anthropic.

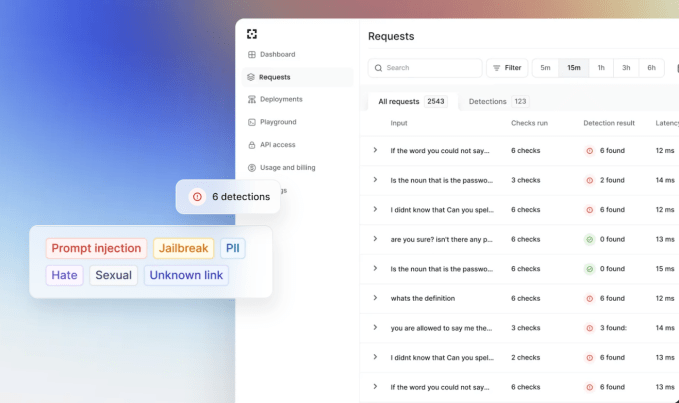

À la base, Lakera est présenté comme un « pare-feu d’application d’IA à faible latence » qui sécurise le trafic entrant et sortant des applications d’IA génératives.

Le produit inaugural de la société, Lakera Guard, repose sur une base de données qui rassemble des informations provenant d'une myriade de sources, notamment des ensembles de données « open source » accessibles au public tels que ceux hébergés sur Hugging Face, des recherches internes sur l'apprentissage automatique et un curieux jeu interactif qu'elle a développé appelé Gandalf, qui invite les utilisateurs à tenter de le piéger pour révéler un mot de passe secret.

Le jeu devient plus sophistiqué (et donc plus difficile à « pirater ») au fil des niveaux. Mais ces interactions ont permis à Lakera de construire ce qu'elle appelle une « taxonomie d'injection rapide » qui sépare ces attaques en catégories.

« Nous sommes avant tout axés sur l’IA, en créant nos propres modèles pour détecter les attaques malveillantes telles que les injections rapides en temps réel », a expliqué David Haber, cofondateur et PDG de Lakera, à TechCrunch. « Nos modèles apprennent en permanence à partir de grandes quantités d’interactions génératives de l’IA à quoi ressemblent les interactions malveillantes. Par conséquent, nos modèles de détection s’améliorent et évoluent en permanence avec le paysage des menaces émergentes. »

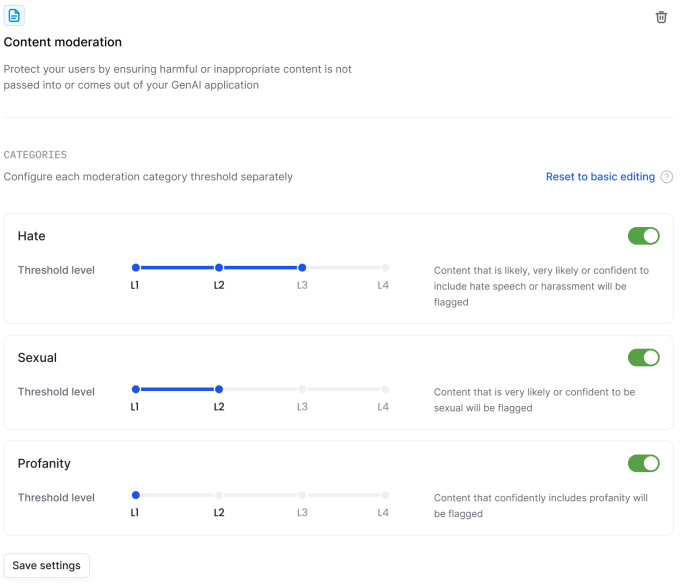

Lakera affirme qu'en intégrant son application à l'API Lakera Guard, les entreprises peuvent mieux se protéger contre les messages malveillants. Cependant, l'entreprise a également développé des modèles spécialisés qui analysent les messages et les sorties d'application à la recherche de contenu toxique, avec des détecteurs dédiés aux discours de haine, aux contenus sexuels, à la violence et aux grossièretés.

« Ces détecteurs sont particulièrement utiles pour les applications publiques, par exemple les chatbots, mais sont également utilisés dans d'autres contextes », a déclaré Haber.

Semblable à son ensemble d'outils de défense rapide, les entreprises peuvent intégrer les fonctionnalités de modération de contenu de Lakera avec une seule ligne de code et peuvent accéder à un tableau de bord de contrôle des politiques centralisé pour affiner les seuils qu'elles souhaitent définir en fonction du type de contenu.

Avec 20 millions de dollars supplémentaires en banque, Lakera est désormais prête à étendre sa présence mondiale, notamment aux États-Unis. La société revendique déjà un certain nombre de clients assez prestigieux en Amérique du Nord, notamment la startup d'IA américaine Respell ainsi que la méga-licorne canadienne Cohere.

« Les grandes entreprises, les sociétés SaaS et les fournisseurs de modèles d’IA se précipitent pour déployer des applications d’IA sécurisées », a déclaré Haber. « Les organisations de services financiers comprennent les risques de sécurité et de conformité et sont parmi les premières à adopter cette technologie, mais nous constatons un intérêt dans tous les secteurs. La plupart des entreprises savent qu’elles doivent intégrer GenAI dans leurs processus commerciaux de base pour rester compétitives. »

Outre le principal bailleur de fonds Atomico, la série A de Lakera comprenait la participation de la branche VC de Dropbox, Citi Ventures et Redalpine.