Il devient de plus en plus coûteux de développer et d’exploiter l’IA. Les coûts d'exploitation de l'IA d'OpenAI pourraient atteindre 7 milliards de dollars cette année, tandis que le PDG d'Anthropic a récemment suggéré que des modèles coûtant plus de 10 milliards de dollars pourraient bientôt arriver.

La recherche de moyens de rendre l’IA moins chère est donc ouverte.

Certains chercheurs se concentrent sur les techniques permettant d'optimiser les architectures de modèles existantes, c'est-à-dire la structure et les composants qui font fonctionner les modèles. D’autres développent de nouvelles architectures qui, selon eux, ont de meilleures chances d’évoluer à moindre coût.

Karan Goel fait partie de ce dernier camp. Au sein de la startup qu'il a contribué à fonder Cartesia, Goel travaille sur ce qu'il appelle des modèles d'espace d'état (SSM), une architecture de modèle plus récente et très efficace qui peut gérer de grandes quantités de données (texte, images, etc.) à la fois. .

« Nous pensons que de nouvelles architectures de modèles sont nécessaires pour créer des modèles d'IA vraiment utiles », a déclaré Goel à TechCrunch. « L’industrie de l’IA est un espace compétitif, à la fois commercial et open source, et la création du meilleur modèle est essentielle au succès. »

Racines académiques

Avant de rejoindre Cartesia, Goel était titulaire d'un doctorat. candidat au laboratoire d'IA de Stanford, où il a travaillé, entre autres, sous la direction de l'informaticien Christopher Ré. À Stanford, Goel a rencontré Albert Gu, chercheur en doctorat. candidat dans le laboratoire, et les deux ont esquissé ce qui allait devenir le SSM.

Goel a finalement accepté un emploi chez Snorkel AI, puis Salesforce, tandis que Gu est devenu professeur adjoint à Carnegie Mellon. Mais Gu et Goel ont continué à étudier les SSM, publiant plusieurs articles de recherche essentiels sur l'architecture.

En 2023, Gu et Goel — ainsi que deux de leurs anciens pairs de Stanford, Arjun Desai et Brandon Yang — ont décidé d'unir leurs forces pour lancer Cartesia afin de commercialiser leurs recherches.

Cartesia, dont l'équipe fondatrice comprend également Ré, est à l'origine de nombreux dérivés de Mamba, peut-être le SSM le plus populaire aujourd'hui. Gu et le professeur Tri Dao de Princeton ont lancé Mamba en tant que projet de recherche ouvert en décembre dernier et continuent de l'affiner au travers de versions ultérieures.

Cartesia s'appuie sur Mamba en plus de former ses propres SSM. Comme tous les SSM, Cartesia donne à l'IA quelque chose comme une mémoire de travail, rendant les modèles plus rapides – et potentiellement plus efficaces – dans la façon dont ils exploitent la puissance de calcul.

SSM vs transformateurs

Aujourd'hui, la plupart des applications d'IA, de ChatGPT à Sora, sont alimentées par des modèles dotés d'une architecture de transformateur. Lorsqu'un transformateur traite des données, il ajoute des entrées à ce qu'on appelle un « état caché » pour « se souvenir » de ce qu'il a traité. Par exemple, si le modèle parcourt un livre, les valeurs d’état cachées pourraient être des représentations de mots dans le livre.

L’état caché explique en partie la raison pour laquelle les transformateurs sont si puissants. Mais c'est aussi la cause de leur inefficacité. Pour « dire » ne serait-ce qu’un seul mot sur un livre qu’un transformateur vient d’ingérer, le modèle devrait parcourir l’intégralité de son état caché – une tâche aussi exigeante en termes de calcul que la relecture du livre entier.

En revanche, les SSM compressent chaque point de données antérieur en une sorte de résumé de tout ce qu'ils ont vu auparavant. À mesure que de nouvelles données arrivent, « l'état » du modèle est mis à jour et le SSM supprime la plupart des données précédentes.

Le résultat ? Les SSM peuvent gérer de grandes quantités de données tout en surpassant les transformateurs sur certaines tâches de génération de données. Avec les coûts d’inférence tels qu’ils sont, c’est une proposition effectivement attrayante.

Préoccupations éthiques

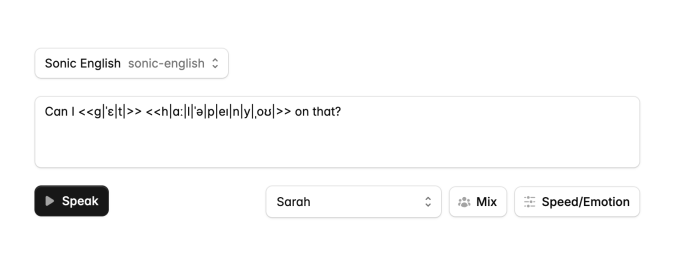

Cartesia fonctionne comme un laboratoire de recherche communautaire, développant des SSM en partenariat avec des organisations externes et internes. Sonic, le dernier projet de la société, est un SSM capable de cloner la voix d'une personne ou de générer une nouvelle voix et d'ajuster le ton et la cadence de l'enregistrement.

Goel affirme que Sonic, disponible via une API et un tableau de bord Web, est le modèle le plus rapide de sa catégorie. « Sonic est une démonstration de la façon dont les SSM excellent sur les données à contexte long, comme l'audio, tout en maintenant la barre de performances la plus élevée en matière de stabilité et de précision », a-t-il déclaré.

Bien que Cartesia ait réussi à expédier des produits rapidement, elle s'est heurtée à bon nombre des mêmes pièges éthiques qui ont tourmenté d'autres fabricants de modèles d'IA.

Cartesia a formé au moins certains de ses SSM sur The Pile, un ensemble de données ouvertes connu pour contenir des livres protégés par le droit d'auteur sans licence. De nombreuses sociétés d’IA affirment que la doctrine de l’utilisation équitable les protège des poursuites pour contrefaçon. Mais cela n'a pas empêché les auteurs de poursuivre Meta et Microsoft, ainsi que d'autres, pour avoir prétendument formé des modèles sur The Pile.

Et Cartesia dispose de peu de garanties apparentes pour son cloneur vocal alimenté par Sonic. Il y a quelques semaines, j'ai pu créer un clone de la voix de l'ancienne vice-présidente Kamala Harris à l'aide de discours de campagne (écoutez ci-dessous). L'outil de Cartesia nécessite uniquement que vous cochiez une case indiquant que vous respecterez les ToS de la startup.

Cartesia n'est pas nécessairement pire à cet égard que les autres outils de clonage vocal du marché. Cependant, avec des informations selon lesquelles des clones vocaux ont déjoué les contrôles de sécurité des banques, l'optique n'est pas étonnante.

Goel ne dirait pas que Cartesia ne forme plus de modèles sur The Pile. Mais il a abordé les problèmes de modération, déclarant à TechCrunch que Cartesia a mis en place des systèmes de « révision automatisée et manuelle » et « travaille sur des systèmes de vérification vocale et de filigrane ».

« Nous avons des équipes dédiées qui testent des aspects tels que les performances techniques, les utilisations abusives et les biais », a déclaré Goel. «Nous établissons également des partenariats avec des auditeurs externes pour fournir une vérification indépendante supplémentaire de la sécurité et de la fiabilité de nos modèles… Nous reconnaissons qu'il s'agit d'un processus continu qui nécessite un perfectionnement constant.»

Entreprise naissante

Goel affirme que « des centaines » de clients paient pour l'accès à l'API Sonic, la principale source de revenus de Cartesia, y compris l'application d'appel automatisé Goodcall. L'API de Cartesia est gratuite jusqu'à 100 000 caractères lus à haute voix, le forfait le plus cher atteignant 299 $ par mois pour 8 millions de caractères. (Cartesia propose également un niveau entreprise avec un support dédié et des limites personnalisées.)

Par défaut, Cartesia utilise les données des clients pour entraîner ses modèles – une politique courante, mais peu susceptible de plaire aux utilisateurs soucieux de leur confidentialité. Goal note que les utilisateurs peuvent se désinscrire s'ils le souhaitent et que Cartesia propose des politiques de rétention personnalisées pour les grandes organisations.

Les pratiques de Cartesia en matière de données ne semblent pas nuire à l'activité, pour ce que ça vaut – du moins pas tant que Cartesia possède un avantage technique. Le PDG de Goodcall, Bob Summers, a déclaré qu'il avait choisi Sonic parce que c'était le seul modèle de génération vocale avec une latence inférieure à 90 millisecondes.

« [It] a surperformé sa deuxième meilleure alternative d'un facteur quatre », a ajouté Summers.

Aujourd'hui, Sonic est utilisé pour les jeux, le doublage vocal et bien plus encore. Mais Goel pense que cela ne fait qu’effleurer la surface de ce que les MSS peuvent faire.

Sa vision est celle de modèles qui s'exécutent sur n'importe quel appareil et comprennent et génèrent n'importe quelle modalité de données (texte, images, vidéos, etc.) presque instantanément. Dans un petit pas dans cette direction, Cartesia a lancé cet été une version bêta de Sonic On-Device, une version de Sonic optimisée pour fonctionner sur les téléphones et autres appareils mobiles pour des applications telles que la traduction en temps réel.

Aux côtés de Sonic On-Device, Cartesia a publié Edge, une bibliothèque logicielle permettant d'optimiser les SSM pour différentes configurations matérielles, et Rene, un modèle de langage compact.

« Nous avons une grande vision à long terme : devenir le modèle de base multimodal incontournable pour chaque appareil », a déclaré Goel. « Notre feuille de route à long terme comprend le développement de modèles d’IA multimodaux, dans le but de créer une intelligence en temps réel capable de raisonner sur des contextes massifs. »

Pour que cela se réalise, Cartesia devra convaincre de nouveaux clients potentiels que son architecture vaut la peine de subir la courbe d'apprentissage. Il devra également garder une longueur d'avance sur les autres fournisseurs qui expérimentent des alternatives au transformateur.

Les startups Zephyra, Mistral et AI21 Labs ont formé des modèles hybrides basés sur Mamba. Ailleurs, Liquid AI, dirigé par la sommité de la robotique Daniela Rus, développe sa propre architecture.

Goel affirme cependant que Cartesia, qui compte 26 employés, est en bonne position pour réussir – en partie grâce à une nouvelle injection de liquidités. La société a clôturé ce mois-ci un cycle de financement de 22 millions de dollars mené par Index Ventures, portant le total levé de Cartesia à 27 millions de dollars.

Shardul Shah, partenaire chez Index Ventures, voit la technologie de Cartesia piloter un jour des applications pour le service client, les ventes et le marketing, la robotique, la sécurité, etc.

« En remettant en question le recours traditionnel aux architectures basées sur des transformateurs, Cartesia a ouvert de nouvelles façons de créer des applications d'IA en temps réel, rentables et évolutives », a-t-il déclaré. « Le marché exige des modèles plus rapides et plus efficaces, pouvant fonctionner partout, des centres de données aux appareils. La technologie de Cartesia est particulièrement bien placée pour tenir cette promesse et piloter la prochaine vague d'innovation en matière d'IA.

A* Capital, Conviction, General Catalyst, Lightspeed et SV Angel ont également participé au dernier cycle de financement de Cartesia, basé à San Francisco.